线性回归

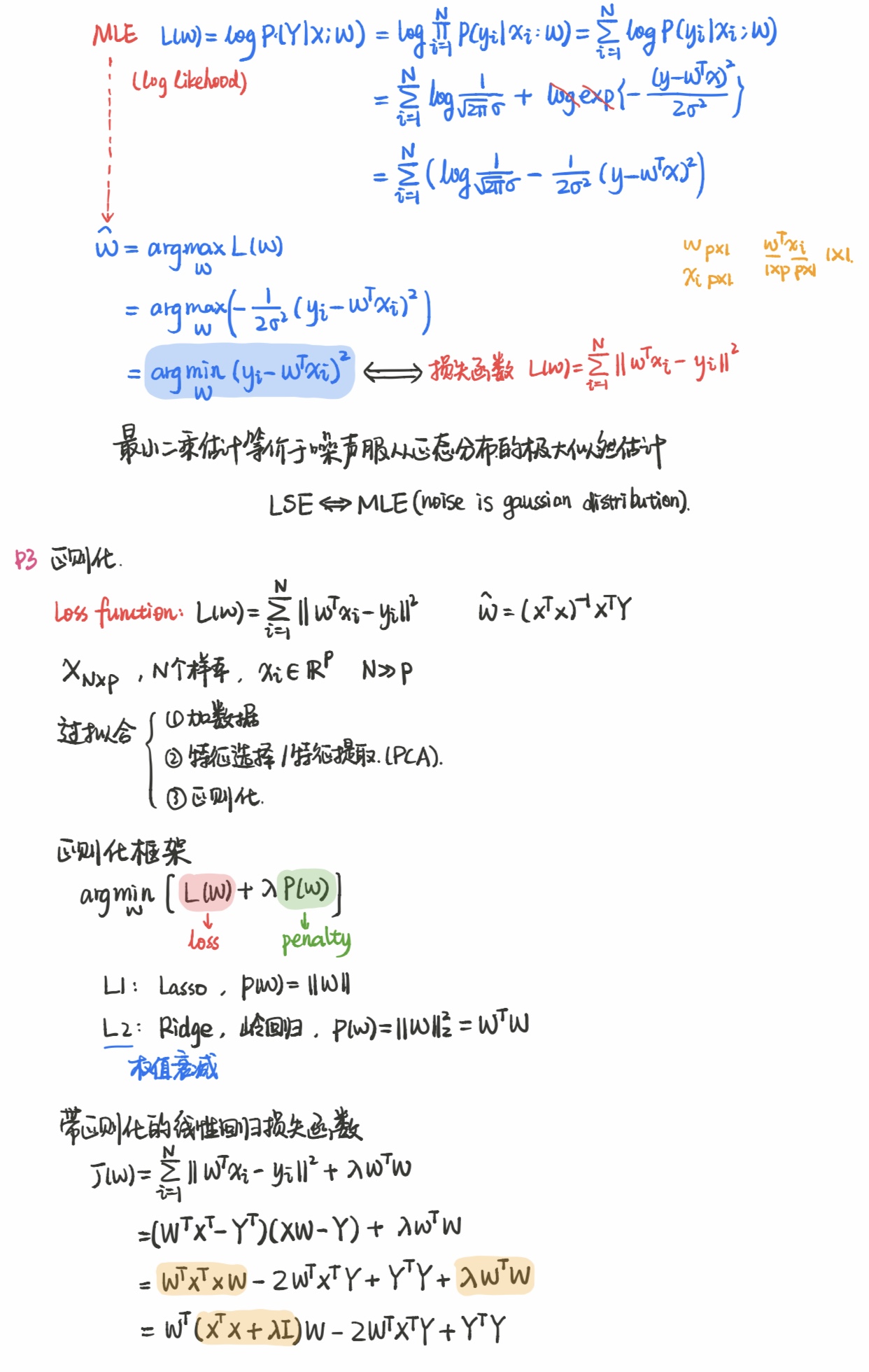

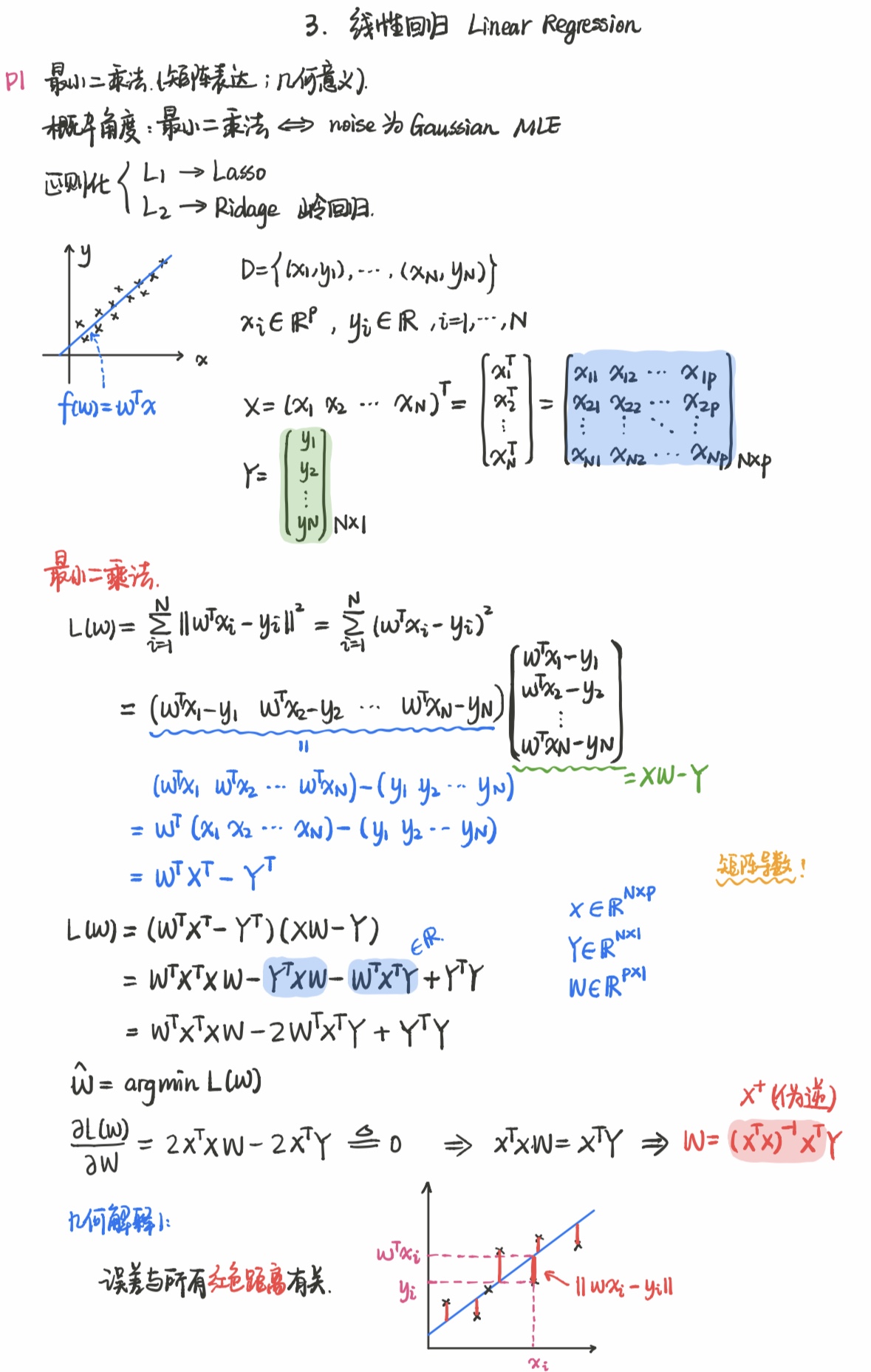

P1最小二乘法 & P2概率视角

- 最小二乘法其实又叫最小平方法,是一种数据拟合的优化技术。实质上是利用最小误差的平方寻求数据的最佳匹配函数,利用最小二乘法可以便捷的求得未知的数据,起到预测的作用,并且是的这些预测的数据与实际数据之间的误差平方和达到最小。一般应用在曲线拟合的目的上。

拟合示意图python代码

1 | #%% |

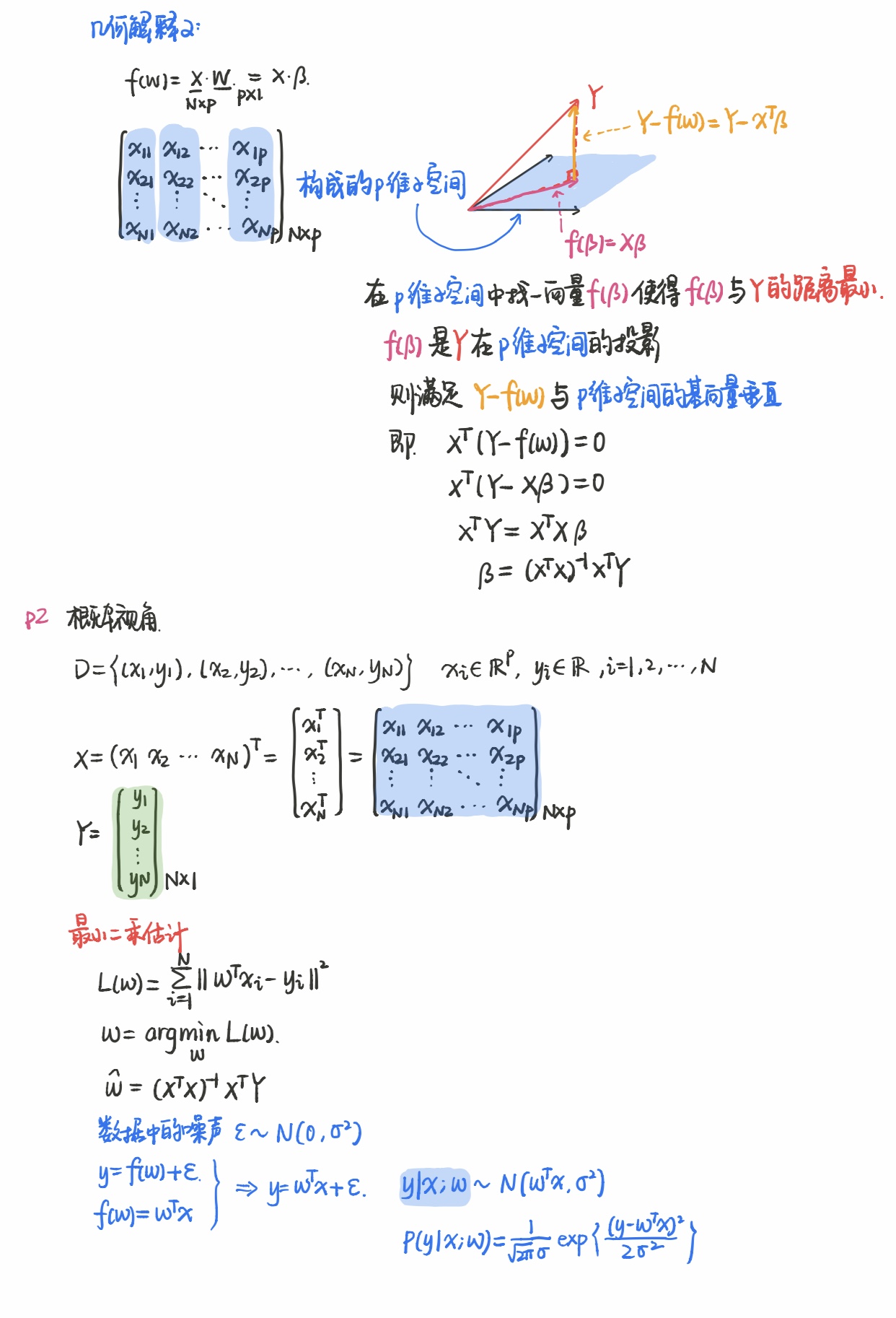

P3正则化 & 正则化几何解释

- 正则化看起来有些抽象,其直译”规则化”,本质其实很简单,就是给模型加一些规则限制,约束要优化参数,目的是防止过拟合。其中最常见的规则限制就是添加先验约束,其中L1相当于添加Laplace先验,L相当于添加Gaussian先验。

- L1正则是在原始的loss函数上加上一个L1正则化项,这个L1正则项实际就是在loss函数上添加一个结构化风险项,因此正则化其实和“带约束的目标函数”是等价的。而L1正则项就是一个1范数,本质相当于添加一个Laplace先验知识。同理,L2正则化项是一个2范数,本质却相当于添加一个Gaussian先验知识。

- 过拟合的时候,拟合函数的系数往往非常大,为什么?如P4所示,过拟合,就是拟合函数需要顾忌每一个点,最终形成的拟合函数波动很大。在某些很小的区间里,函数值的变化很剧烈。这就意味着函数在某些小区间里的导数值(绝对值)非常大,由于自变量值可大可小,所以只有系数足够大,才能保证导数值很大。

- 一般来说,监督学习可以看做最小化P3的损失函数,第一项L衡量我们的模型(分类或者回归)对第i个样本的预测值f(xi;w)和真实的标签yi之前的误差。因为我们的模型是要拟合我们的训练样本的嘛,所以我们要求这一项最小,也就是要求我们的模型尽量的拟合我们的训练数据。但正如上面说言,我们不仅要保证训练误差最小,我们更希望我们的模型测试误差小,所以我们需要加上第二项,也就是对参数w的规则化函数Ω(w)去约束我们的模型尽量的简单。其中这个规则化函数就是我们常见的L0,L1,L2范数。

- 正则化的目的:防止过拟合!

- 正则化的本质:约束(限制)要优化的参数。

- 贝叶斯决策理论是主观贝叶斯派归纳理论的重要组成部分。 贝叶斯决策就是在不完全情报下,对部分未知的状态用主观概率估计,然后用贝叶斯公式对发生概率进行修正,最后再利用期望值和修正概率做出最优决策。贝叶斯决策理论方法是统计模型决策中的一个基本方法,其基本思想是:

- 已知类条件概率密度参数表达式和先验概率

- 利用贝叶斯公式转换成后验概率

- 根据后验概率大小进行决策分类

- 从贝叶斯角度理解正则化

从我们平时最为熟悉的最小二乘回归、Ridge回归和LASSO回归入手。从概率论的角度:

Least Square的解析解可以用Gaussian分布以及最大似然估计求得

Ridge回归可以用Gaussian分布和最大后验估计解释

LASSO回归可以用Laplace分布和最大后验估计解释

给定观察数据,贝叶斯方法通过最大化后验概率估计参数w。